La teoria del controllo può essere utile per ridurre la polarizzazione nei social network

Parliamo di una parola che mette tutti a disagio: "doomscrolling". Nell'era della rapida diffusione delle informazioni sui social media, purtroppo, è qualcosa che tutti facciamo nel tempo libero. La prossima volta che scorrerete distrattamente Instagram o TikTok, vorrei incoraggiarvi a riflettere su come queste app vi tengono incollati allo schermo.

Ogni piattaforma di social media ha un "algoritmo di raccomandazione" integrato che traccia la vostra attività su quella piattaforma (ad esempio: tempo trascorso su un particolare video, like/dislike, commenti ecc.) e cerca di valutare i vostri interessi. Sulla base di questa attività, l'algoritmo propone nuovi post con cui è più probabile che interagiate nuovamente. Questo è ciò che chiamiamo "apprendimento supervisionato” nell'intelligenza artificiale (AI).

Quindi, il modo comprovato per mantenere gli utenti coinvolti è quello di proporre loro contenuti simili a quelli con cui hanno interagito: è semplice. Non c'è da stupirsi che Google e Meta guadagnino miliardi ogni anno dai social media. Ma c'è un lato oscuro di questi algoritmi, la cui prima vittima sono gli utenti, cioè noi.

I post polarizzanti vi hanno incollato ai vostri telefoni

Sì, e probabilmente non ve ne rendete nemmeno conto. Le aziende di social media guadagnano un sacco di soldi solo quando scorri all'infinito il tuo telefono... cosa che è meno probabile che accada se promuovono post più articolati. Sfortunatamente, questo significa che l'algoritmo promuove in modo schiacciante contenuti estremi per mantenere alto il coinvolgimento. In vista delle elezioni statunitensi del 2024, ne sono stato testimone io stesso, notando su X (ex Twitter) post estremamente favorevoli ai Democratici o ai Repubblicani, che spesso demonizzavano l'altro partito al punto da risultare inquietanti da guardare. Man mano che un numero maggiore di utenti interagisce con questi articoli, grazie ai loro titoli accattivanti e provocatori (spesso mescolati a notizie false non verificate), questi post ottengono maggiore visibilità, portando più persone a visualizzare questi articoli.

Ma perché le persone leggono questi articoli e perfino interagiscono con essi? Tutti noi mostriamo un "pregiudizio di conferma", ovvero la tendenza a incoraggiare pensieri e comportamenti conformi alle nostre convinzioni esistenti. Tutti abbiamo le nostre opinioni su ciò che accade ogni giorno e l'algoritmo di raccomandazione è abbastanza intelligente da sfruttarle per i propri scopi. Poiché il sistema di raccomandazione continua a mostrarci articoli che rafforzano le nostre convinzioni precedenti, è probabile che ci convinciamo ancora di più delle nostre posizioni iniziali su un argomento, portando alla formazione di "bolle" e "camere di risonanza". A livello sociale, questo porta alla polarizzazione e non si può sopravvalutare quanto ciò sia pericoloso.

Il problema urgente è che i moderni algoritmi di raccomandazione sono, di fatto, progettati in questo modo per massimizzare i profitti attraverso la visibilità (anche se le aziende miliardarie sostengono il contrario), disturbando così l'armonia sociale. Un aspetto ancora più sinistro è che le fake news si insinuano negli algoritmi senza essere rilevate e che le persone che progettano gli algoritmi potrebbero perseguire i propri obiettivi.

Tenendo presente questo problema, noi dell'Automatic Control Laboratory e dell'NCCR Automation eravamo interessati a scoprire se fosse possibile sviluppare algoritmi di raccomandazione in grado di mantenere alto il coinvolgimento senza polarizzare le società, e la buona notizia è che potremmo aver trovato una soluzione!

Equilibrio tra coinvolgimento e polarizzazione

Immaginate di voler acquistare un laptop online. Normalmente, quello che faremmo sarebbe chiedere opinioni su quel laptop alla nostra cerchia di amicizie o al lavoro, dopodiché prenderemmo una decisione. Allo stesso modo, ogni volta che leggiamo notizie interessanti online, ne discutiamo con i nostri colleghi e le nostre colleghe durante il pranzo e poi ci formiamo un'opinione su quell'argomento. Pertanto, la nostra rete gioca un ruolo importante nel processo decisionale, soprattutto online.

Purtroppo, i sistemi di raccomandazione utilizzati dalle grandi aziende di social media che fanno uso dell'intelligenza artificiale non tengono esplicitamente conto di questa rete. Sì, gli algoritmi tracciano le persone con cui sei connesso sui social media e le tue attività, ma non ne fanno un uso costruttivo. La maggior parte degli algoritmi dà una priorità schiacciante alla "personalizzazione" (cioè al modo in cui interagisci con la piattaforma) piuttosto che alla "consapevolezza della rete" (cioè al modo in cui interagisci con gli altri sulla piattaforma).

Abbiamo intuito che, poiché la polarizzazione delle società e la formazione di bolle era più un fenomeno di rete (piuttosto che qualcosa che derivava esclusivamente dalla personalizzazione), potevamo utilizzare esplicitamente la rete per ridurre la polarizzazione, continuando a utilizzare algoritmi personalizzati per aumentare il coinvolgimento. Questo è ciò che chiamiamo un sistema di raccomandazione "consapevole della rete".

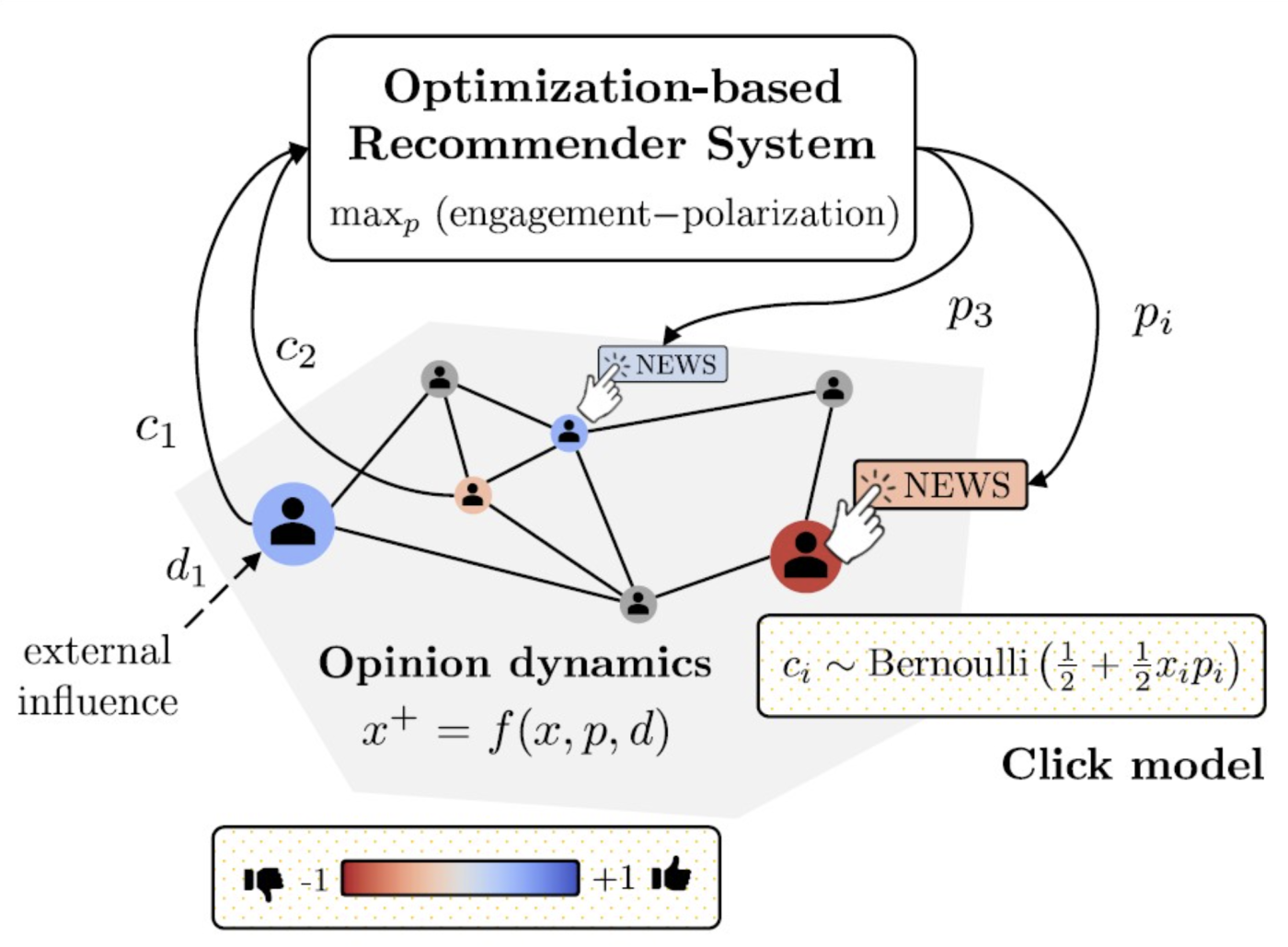

Per svolgere questo compito specifico, abbiamo sviluppato un problema di ottimizzazione che si presentava così:

massimizzare funzione obiettivo (coinvolgimento - polarizzazione) (1)

soggetto a vincoli di e (dinamiche di opinione)

In un tipico problema di ottimizzazione, c'è una funzione obiettivo che è uno "scopo" (in questo contesto, massimizzare il coinvolgimento riducendo al minimo la polarizzazione), insieme a vincoli che possono impedire di ottenere la soluzione migliore. In questo contesto, si tratta dell'evoluzione temporale delle opinioni in un circuito chiuso con gli articoli consigliati e l'influenza di altri utenti.

Quali sono le sfide nella progettazione di un algoritmo di questo tipo?

Qualsiasi algoritmo di raccomandazione può apprendere le tue preferenze e ottimizzarle di conseguenza, utilizzando strumenti di intelligenza artificiale ben sviluppati. Pertanto, la parte relativa alla massimizzazione del coinvolgimento non è troppo difficile da risolvere. Tuttavia, minimizzare la polarizzazione significa che il sistema di raccomandazione dovrebbe conoscere la tua posizione (ad esempio, su una scala da -1 a +1, +1 se sei fortemente orientato verso i Democratici, contro -1 se sei fortemente a favore dei Repubblicani) e apprendere quanto sei connesso con la tua rete. Questo non è banale da ottenere.

In una situazione realistica, non dirai esplicitamente a X o Instagram che preferisci una parte rispetto all'altra, né loro te lo chiederanno. Una violazione così esplicita della privacy causerebbe indignazione (anche se alcuni algoritmi hanno i loro modi sfacciati per scoprirlo!). Non dirai loro nemmeno quali sono le opinioni che apprezzi di più nella tua rete, né chi odi di più. Inoltre, la piattaforma di social media non conosce le tue preferenze quando si tratta di visualizzare articoli; ad esempio, potresti essere più incline a leggere qualcosa dal Guardian piuttosto che dal Telegraph.

Pertanto, le tue opinioni in tempo reale, il modo in cui percepisci il tuo social network e come visualizzi gli articoli, ovvero il tuo comportamento di clic, sono a priori sconosciuti all'algoritmo.

A quanto pare, un algoritmo "consapevole della rete" ci aiuta immensamente!

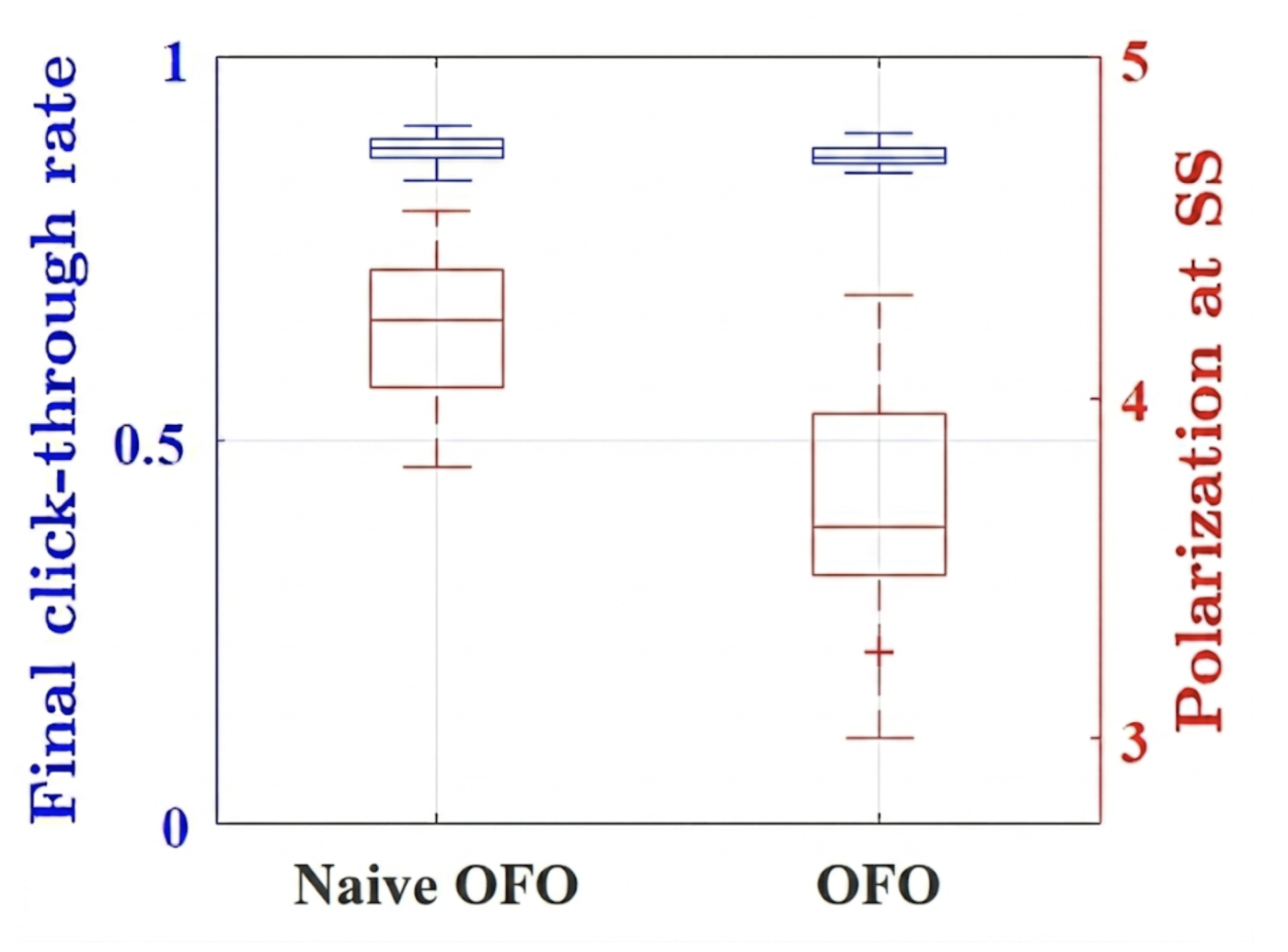

Utilizziamo una combinazione di algoritmi di stima standard nella teoria del controllo e reti neurali per risolvere questi problemi e impieghiamo l' "ottimizzazione del feedback online" (OFO), uno strumento molto utile (anch'esso sviluppato dalle ricercatrici e dai ricercatori dell'NCCR Automation!) per risolvere il problema di ottimizzazione in (1).

Dopo aver eseguito alcune simulazioni e averle confrontate con un caso ipotetico (in cui l'obiettivo era solo la personalizzazione e la rete veniva ignorata), siamo stati in grado di dimostrare che il nostro algoritmo funzionava molto meglio in termini di mantenimento di alti livelli di coinvolgimento, riducendo al contempo la polarizzazione nei social network (vedi Fig. 2).

I nostri risultati empirici dimostrano essenzialmente che non è necessario sacrificare il coinvolgimento sulle piattaforme dei social media per ridurre al minimo la polarizzazione. Ci auguriamo sinceramente che in futuro le grandi piattaforme modifichino i loro algoritmi a favore di progetti "sicuri" che promuovano una minore radicalizzazione e lavorino attivamente per raggiungere l'obiettivo urgente di ridurre la polarizzazione nei social network.

Per una spiegazione tecnica completa e rigorosa del nostro algoritmo, rimandiamo i lettori a questo articolo scientifico.

*"Stato stazionario" nella teoria del controllo è solo un eufemismo che rappresenta la fine di una simulazione